在增强现实(AR)和人工智能(AI)的交汇点上,Meta的研究人员通过Transformer技术,开创了一种新颖的场景理解方法——SceneScript。这项技术以其70M的参数量,通过编码器-解码器架构,将真实世界的场景转化为精简的几何表示,为虚拟叠加现实带来了前所未有的效果。

工具简介与背景

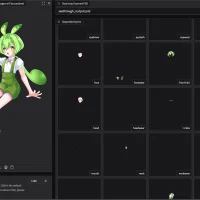

SceneScript是一种自回归结构化语言模型,它能够将视觉输入转换成场景的几何图形表示。这项技术不仅能够助力AR和AI设备理解物理空间的几何形状,还能在虚拟与现实之间架起一座桥梁。

主要功能与产品特色

- 端到端学习:SceneScript通过自回归学习,直接从视觉数据中推断出结构化语言命令。

- 参数效率:仅需70M参数,便能实现复杂的场景理解任务。

- 快速推理:即便使用原始Transformer,也能在2-3秒内解码中等大小的场景。

- 扩展性:能够轻松扩展到新任务,无需改变视觉输入和网络架构。

需求人群与变现技巧

- AR/MR游戏开发者:利用SceneScript技术,可以创造出更加沉浸式的游戏体验。

- AI研究者:SceneScript提供了一种新的工具,用于研究和开发理解物理空间的AI系统。

使用场景示例

- 虚拟叠加现实:通过SceneScript,可以将虚拟元素叠加到真实世界的场景中,为用户带来新奇的视觉体验。

- 室内设计:利用SceneScript的几何表示能力,可以帮助设计师快速预览设计效果。

费用定价

目前,SceneScript仅供Meta的内部研究团队使用,具体的定价信息尚未公开。

结语

SceneScript的推出,不仅是Meta在AI场景理解领域的一次重大创新,也为AR和AI设备的未来发展提供了新的可能性。随着技术的不断进步,我们有理由期待SceneScript将在更多领域展现其独特的价值。

🔗 论文地址:SceneScript: Reconstructing Scenes With An Autoregressive Structured Language Model